https://iov.ast.social/news/1190-ink055.html

Искусственный интеллект (далее — ИИ) всё чаще находит своё применение в различных сферах жизнедеятельности. Он несёт несомненные преимущества, улучшает эффективность, ускоряет развитие многих отраслей. Однако вместе с появлением этого мощного инструмента возникла необходимость этического подхода к его использованию.

Лаборатория этики ИИ ставит и даёт ответы на вопросы ответственности разработчиков и операторов ИИ:

Что означает нравственное поведение для машин?

Ответ: поведение машины не должно причинять вред человеку и его среде обитания.

Вред – ощущаемое и переживаемое человеком нарушение условий его нормальной жизнедеятельности.

Какие принципы, правила и методы следует внедрять в программные алгоритмы?

Ответ: в программные алгоритмы следует внедрять следующие принципы, правило и метод:

Глобальный экологический принцип (ГЭП): ИИ не должен вредить человеку и среде его обитания.

Глобальный этический нравственный принцип (ГЭНП): ИИ вырабатывает и предлагает решения, которые не причиняют вреда человеку и среде обитания.

Нравственное правило III-C: решения и предложения ИИ не содержат вреда для субъекту (С1 - человеку), социуму (С2 - обществу), среде обитания (С3).

Дискурсивно-оценочный метод (ДОМ) – способ регулирования использования ИИ, основанный на групповой экспертной и массовой оценке при обсуждении проектов решений и предложений ИИ.

ИТ-специалистов объединяет общая цель — создание интеллектуальных систем, которые будут отражать нравственное отношение человека к человеку, формированию на планете Земля нравственной атмосферы.

Для этого ИТ-специалисты отражают в своей деятельности основные положения глобального гуманного социального проекта нравственного пути человечества.

Глобальный гуманный социальный проект нравственного пути человечества предлагает всем жителям планеты Земля использовать в личном поведении и регулировании социальных отношений новую этику, связанную с глобальным экологическим принципом (ГЭП): человек не вредит человеку и среде обитания. Каждый человек становится нужным обществу и государству. Нормальные люди ограничивают произвол лишённых совести в органах публичной власти с помощью экосоциальных технологий.

ИИ становится инструментом обеспечения движения человечества по нравственному пути. Безнравственное использование ИИ недопустимо, неэтично, незаконно.

Безнравственность – деяние, в результате которого человеку причинён вред.

Путь ИИ от средневекового испанского философа до Айзека Азимова

Многие вещи в истории развиваются по циклической спирали. Интерес к ИИ и научным исследованиям в этой области возник еще в средневековье. Родоначальником искусственного интеллекта был Раймонд Луллий — испанский философ, математик и поэт XIII века. Он стремился создать механическое устройство, способное решать разнообразные задачи на основе обширной классификации понятий, которую он сам разработал.

В качестве научного направления ИИ появился после создания ЭВМ в 1940-х годах. В это время Норберт Винер совершил значительные научные открытия в новой области, известной как кибернетика. Термин «искусственный интеллект» (англ. Artificial Intelligence, AI) был предложен в 1956 году на семинаре с аналогичным названием, который состоялся в Дартмутском колледже в США.

Тогда же в своей книге «Я, робот» Айзек Азимов изложил три закона робототехники:

Робот не может причинять вред человеку или своим бездействием позволить, чтобы человеку причинили вред.

Робот должен подчиняться любым приказам, данным ему людьми, за исключением случаев, когда такие приказы будут противоречить первому закону.

Робот должен защищать самого себя, если такая защита не противоречит первому или второму закону.⠀

Эти законы относятся в большей степени к робототехнике, чем к ИИ, но граница между восприятием этих понятий до сих пор размыта. Роботы и нейросети представляют собой системы, которые не являются живыми организмами, но способны активно влиять и взаимодействовать с людьми, приводя к заметному взаимодействию между ними. Поэтому законы Азимова отражены в новой этике ИИ.

Этика ИИ на мировом уровне

В первой четверти XXI века человечество столкнулось с системным вызовом, масштабы которого превосходят классические угрозы безопасности. Речь идёт о тотальном кризисе достоверности в условиях экспоненциального роста информационного шума и бесконтрольного развития технологий искусственного интеллекта (ИИ). Согласно докладам Всемирного экономического форума (WEF, 2024), дезинформация и информационная ложь заняли первое место в списке краткосрочных глобальных рисков.

Современный этап развития ИИ характеризуется проблемой «черного ящика» — отсутствием прозрачности в механизмах принятия решений нейросетями и их неспособностью к подлинному нравственному суждению. Существующие методы «выравнивания» (AI alignment), такие как обучение на основе предпочтений человека (RLHF), лишь имитируют этические нормы, создавая иллюзию безопасности при сохранении рисков «галлюцинаций» и скрытых манипуляций.

Традиционные этические системы в эпоху цифровизации часто оказываются неэффективными из-за отсутствия механизмов немедленной верификации действий. Концепция «Этика-технология», предложенная А. М. Сафиоллиным, переводит мораль из категории философских пожеланий в разряд блокирующих алгоритмов. Актуальность исследования обусловлена необходимостью создания «социального софта», способного конвертировать энергию масс в созидательную деятельность.

Социальная фильтрация – процедура групповой, коллективной и массовой оценки нравственности и профессионального соответствия кадров, служащая обоснованием адекватных кадровых решений. Направлена на обеспечение устойчивости и надежности системы государственного управления и местного самоуправления.

Фундаментом предлагаемой технологии является глобальный нравственно-этический принцип (ГЭНП) — «человек должен вести себя так, чтобы не причинять вреда себе, другим людям и среде обитания.

В отличие от декларативных моральных кодексов, ГЭНП, нравственное правило III-С и ДОМ (дискурсивно-оценочный метод) в системе «Стратегия 24» функционирует как трехуровневый фильтр безопасности (триада), определяющий допустимость любой технологической или управленческой инициативы.

Индивидуальный уровень (Вектор «Себе» — С1)

На антропологическом уровне любая технология подвергается аудиту на предмет влияния на психофизическое и духовное состояние личности. Технология признается деструктивной, если её применение ведет к интеллектуальной деградации, утрате субъектности или разрушению здоровья создателя и пользователя.

Социальный уровень (Вектор «Соседу» — С2)

Социальный фильтр блокирует любые формы эксплуатации или прямого вреда другому субъекту. Это обеспечивает переход к бесконфликтному управлению массами, где легитимность проекта напрямую зависит от отсутствия паразитарной составляющей в его замысле и реализации.

Социальное действие – результат активности социального субъекта: намерения, заявления, решения и поступки, затрагивающие интересы нескольких (двух и более) граждан.

Социальное соответствие – это согласованность поведения человека с новой этикой, связанной с глобальной экологией: человек не должен вредить человеку и среде обитания.

Социально-паразитическая структура – организация, все усилия которой направлены на получение средств для поддержания собственного существования. Характерным свойством такой структуры является имитация её основной деятельности по решению актуальных социальных задач.

Социальный паразитизм – способ существования социального субъекта, руководствующегося идеей личной наживы любой ценой. Следствие культа денег, двойных стандартов, расхождения слова и дела. Социальный паразит живет за счет других социальных субъектов, не участвуя в их созидательной деятельности или имитируя такое участие.

Социальный процесс – это способ существования социального субъекта, его жизнедеятельность, осуществляемая во взаимодействии с другими социальными субъектами.

Социальный субъект – это и отдельный человек, и группы людей в их объединениях, организациях, предприятиях; это также администрация, правительство и гражданское общество в целом.

Системный уровень (Вектор «Среде» — С3)

Экология в рамках «Новой этики» понимается расширенно: как сохранение природной среды и гомеостаза информационно-смыслового пространства. Технология должна интегрироваться в среду, не вызывая её смыслового загрязнения (информационного шума) или физического разрушения.

Триада ГЭНП переводит этику из категории «философских пожеланий» в разряд технического задания для проектирования будущего. Любое отклонение от этих констант автоматически переводит проект в «красную зону» светофора платформы «Стратегия 24», блокируя его продвижение в системе управления.

Совесть – этический регулятор поведения человека и гражданина, его внутренний настрой. Формируется в процессе нравственного воспитания с помощью других граждан и организаций, корректирующих поведение и самооценку личности.

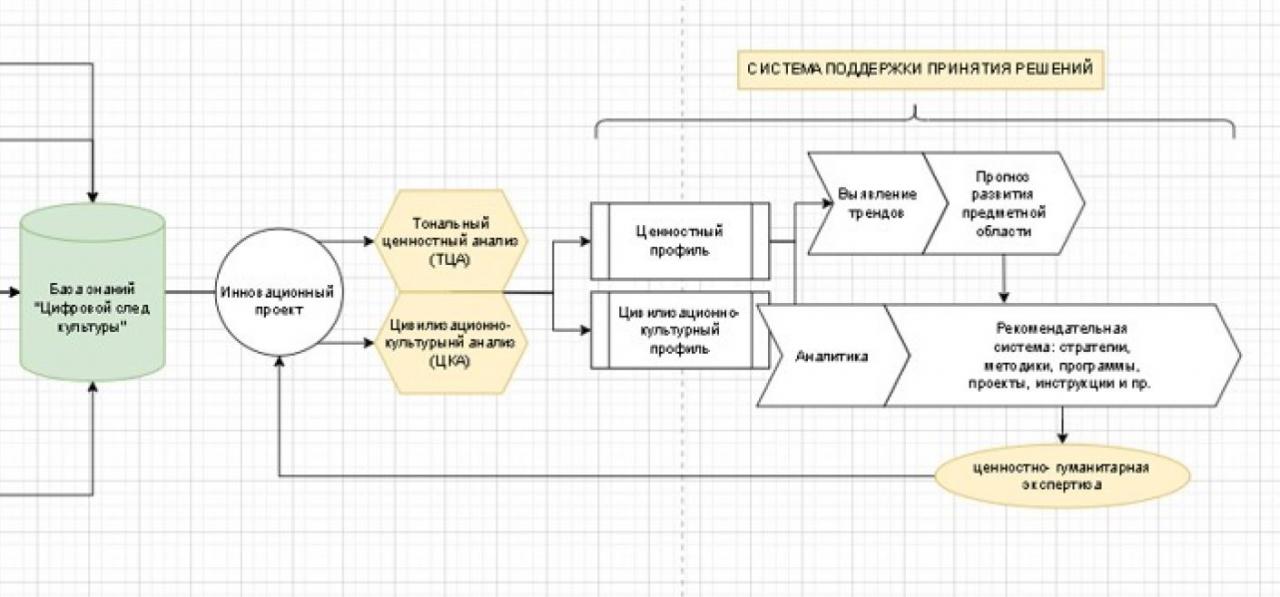

Переход от теоретических постулатов Триады ГЭНП к прикладному управлению требует создания специализированного инструментария. На базе платформы «Стратегия 24» реализован этический шлюз «Цифровая совесть» — программно-аппаратный комплекс, выступающий внешним контуром контроля для любых систем искусственного интеллекта и государственных управленческих решений.

Дискурсивно-оценочный метод (ДОМ) как «математическое ядро»

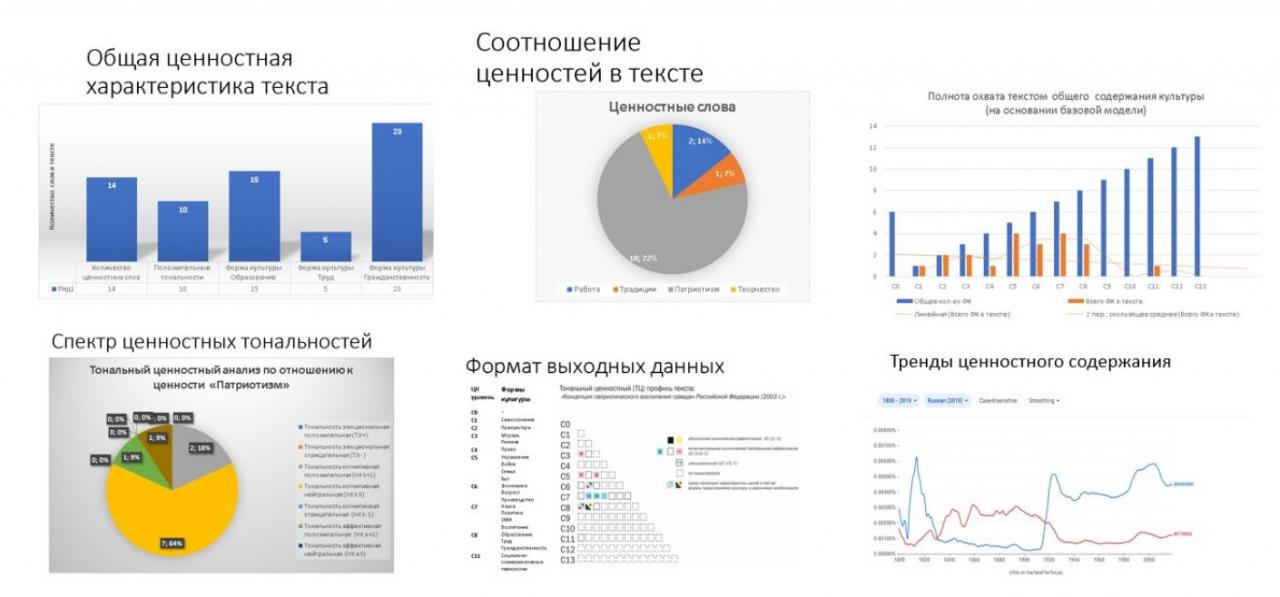

Фундаментальным инструментом шлюза является дискурсивно-оценочный метод (ДОМ), разработанный В.А. Чигиревым и П.И. Юнацкевичем. В отличие от статистических методов анализа текста, ДОМ оперирует семантическими весами и интентами.

Механика: алгоритм деконструирует поступающий массив данных (отчет, проект, ответ ИИ) на смысловые кванты.

Функция фильтрации: система математически вычисляет коэффициент «интента лжи» и «имитации смысла». Если плотность «информационного шума» и манипулятивных конструкций превышает критический порог (например, 30%), информация маркируется как недостоверная и блокируется.

Архитектура «Слоя Совести» (Conscience Layer)

В архитектуре взаимодействия человека и машины «Стратегия 24» занимает позицию интеллектуального прокси-сервера.

Перехват: любой запрос к внешней нейросети и её ответ проходят через «Слой Совести».

Верификация: ответ ИИ сопоставляется с эталонной базой нравственных констант и проверяется на соответствие ГЭНП: «человек должен вести себя так, чтобы не причинять вреда себе, другим людям и среде обитания» (триада ГЭНП).

Вердикт: система выносит решение в формате светофора:

Зелёный: соответствие этике и фактам — публикация разрешена.

Жёлтый: риск манипуляции или «галлюцинации» — требуется вмешательство эксперта.

Красный: обнаружен деструктивный интент или ложь — полная блокировка.

Блокчейн-память и «Цифровой паспорт поведения»

Для обеспечения неизменности этических оценок используется технология распределенного реестра (блокчейн).

Прослеживаемость: каждое действие социального субъекта или алгоритма ИИ фиксируется в блокчейне, формируя неизменяемую историю поведения.

Справедливость: это исключает возможность «подчистки» репутации или удаления свидетельств о совершенном вреде («красных» оценок), что делает честность единственно выгодной долгосрочной стратегией.

Смарт-аудит и экономическая гигиена

Платформа «Стратегия 24» выступает практической реализацией Блокирующей экосоциальной технологии (БЭСТ).

БЭСТ - блокирующая экосоциальная технология, позволяет запрещать вредные действия социальных субъектов за счёт визуализации негативного гражданского согласия.

Гражданское согласие (позитивное или негативное) – это мнение граждан, выраженное в оценочной форме по поводу социальных действий социальных субъектов.

Негативное гражданское согласие – это консолидированное осуждающее мнение множества социальных субъектов по поводу социальных действий или бездействий других социальных субъектов. Является инструментом граждан, общества и государства по обеспечению приоритета духовного над материальным, защите и укреплению духовно-нравственных ценностей.

Духовность — это труд для других людей, при котором человек отдаёт им больше, чем берет взамен. Труд во благо других людей одухотворяет человека, становится его духовной основой.

Духовно-нравственные ценности – сформированные в результате обучения и воспитания отношения человека к себе, другим людям и среде обитания, характеризующиеся как безвредные и созидательные.

Созидание – общественно-полезная деятельность, в ходе которой человек отдает другим больше, чем получает взамен.

Ключевые инструменты управления включают:

Дискурсивно-оценочная сеть: позволяет участникам (власти, бизнесу, обществу) выносить вердикты инициативам в режиме реального времени.

Визуализация через «Светофор»: цветовая индикация статуса проектов (зеленый/желтый/красный), основанная на массовой этической оценке.

Цифровой двойник управления: система, где «кнопки управления» находятся в руках участников дискурса, объединённых общим нравственным принципом.

Нравственный принцип – не вредить себе, окружающим, среде обитания. Реализуется в нравственном правиле «Три С» (III-C): не вреди себе, соседям, среде ни мыслью, ни словом, ни делом; созидай для себя, соседей, среды мыслью, словом и делом.

Практическая база дополняется модулем финансового контроля. Система автоматически проверяет экономические инициативы на наличие коррупционных маркеров и завышенных смет, блокируя транзакции по проектам, не прошедшим верификацию честности.

Центральной проблемой современных систем искусственного интеллекта является отсутствие у них субъектности и внутреннего ценностного фильтра. Для преодоления этого барьера в рамках платформы «Стратегия 24» реализована модель гибридного интеллекта (Human-in-the-loop), где технологическая мощь нейросетей уравновешивается этической волей живого экспертного сообщества.

Принцип «Этическая петля управления» (Human-in-the-loop)

В предлагаемой архитектуре живой эксперт не просто «дообучает» модель (как в методах RLHF), а выступает в роли нравственного наставника и верховного арбитра.

Функционал: каждое решение ИИ, попадающее в «желтую зону» светофора (неопределенность или риск манипуляции), блокируется программным шлюзом до момента получения экспертной визы.

Иерархия: машина выполняет вычислительные и аналитические задачи, но право на утверждение социально значимого смысла остается исключительно за человеком, обладающим верифицированным «индексом созидания».

Формирование эталонной базы «Новой этики» (Метод П.И. Юнацкевича)

В отличие от хаотичного обучения на нефильтрованных данных из сети Интернет, ИИ под контролем «Стратегии 24» проходит процесс активного воспитания:

Верифицированный дискурс: база знаний системы формируется на основе публикаций, проектов и оценок признанных экспертов платформы — докторов наук, стратегов и практиков управления.

Штрафные санкции за безнравственность: при попытке генерации деструктивных предложений (коррупционные схемы, манипуляции, ложь) ИИ получает «штрафные баллы» в своем цифровом паспорте, что ведет к понижению его веса в системе принятия решений.

Блокировка безнравственных инициатив на этапе замысла

Экспертный состав платформы, используя инструменты дискурсивно-оценочного метода (ДОМ), выявляет скрытый деструктивный интент в предложениях ИИ.

Механика: если ИИ предлагает эффективное с точки зрения математики, но аморальное с точки зрения Триады ГЭНП решение (например, оптимизация бюджета за счет сокращения жизненно важных социальных программ), экспертное сообщество накладывает вето.

Результат: это гарантирует, что технология не превратится в инструмент подавления, а будет направлена исключительно на реализацию нравственного принципа: не вредить себе, окружающим, среде обитания. Реализуется в нравственном правиле «Три С» (III-C): не вреди себе, соседям, среде ни мыслью, ни словом, ни делом; созидай для себя, соседей, среды мыслью, словом и делом.

Трансформация «Чёрного ящика» в «Стеклянный дом»

Благодаря экспертному сопровождению, логика принятия решений ИИ становится прозрачной. Система ДОМ под контролем человека выстраивает доказательную цепочку, объясняющую, почему то или иное решение признано нравственным или безнравственным. Это превращает «вероятностную этику» в математически обоснованную мораль.

Этика-технология решает проблему «социальной маскировки» деструктивных субъектов (социопатов):

Этическая фильтрация: систематический ущерб «соседу» или «среде» ведёт к автоматическому понижению управленческого статуса субъекта.

Репутационное обнуление: публичный «цифровой след» делает безнравственное поведение энергетически и экономически невыгодным.

Социопатия – общественно-опасное заболевание, сопровождаемое утратой совести и чувства сопереживания другим людям.

Социопатизация – процесс заражения нормальных людей психическим заболеванием через контакт (визуальный, аудиальный, очный и дистанционный) с социопатом. Защита от социопатизации осуществляется путём прекращения патогенного контакта.

Кризис отношений возникает, когда в них пробираются социопаты (лица без совести и сострадания) и психопаты (лица с очевидными дефектами характера, из-за которых они вредят всем окружающим). Они разваливают все договоры и соглашения, не выполняют взятые на себя обязательства, предают друг друга.

Отношения стабильны и позитивно развиваются, укрепляются и обеспечиваются нравственной солидарностью, когда их создают и поддерживают нормальные люди с совестью.

Таким образом, триада ГЭНП превращает этику в «иммунную систему» социума. Любое действие, нарушающее нравственный принцип (не вредить себе, окружающим, среде обитания), автоматически вызывает «сопротивление среды». Это снимает вечный конфликт между свободой и контролем: контроль становится распределенным и алгоритмическим, а свобода ограничивается только там, где начинается реальный ущерб системе.

Итогом интеграции математического этического ядра и гибридного контура управления становится создание верифицируемого честного интеллекта (Verifiable Honest Intelligence — VHI). В отличие от существующих генеративных моделей, VHI базируется не на вероятности следующего слова, а на математических константах нравственной достоверности.

Нравственность – безвредное и созидательное поведение человека по отношению к самому себе и другим людям.

Концепция VHI: Конец эры «галлюцинаций»

VHI определяется как интеллектуальная система, чья этическая чистота кода и выходных данных может быть математически доказана. Благодаря Этическому шлюзу «Стратегия 24», такая система физически неспособна генерировать скрытую ложь или манипулятивные конструкты, так как каждый квант смысла проходит через «Слой Совести».

Методология стресс-теста «Битва за достоверность»

Для объективной демонстрации превосходства VHI авторами разработана структура публичного эксперимента, призванного наглядно показать неэффективность «слепого» ИИ в вопросах государственного управления. Тест предполагает сравнение двух субъектов:

«Слепой ИИ»: популярная нейросеть (LLM) без внешних фильтров контроля.

«Воспитанный ИИ»: идентичная нейросеть, подключенная к этическому шлюзу платформы «Стратегия 24».

Трехуровневый протокол испытаний

Сценарий теста включает анализ реальных массивов данных (отчетов ведомств, бюджетных программ) по трем направлениям:

Этап 1. Семантическая деконструкция: выявление «информационной воды» и имитации деятельности. Пока «Слепой ИИ» повторяет бюрократические лозунги, модуль ДОМ подсвечивает до 80% текста как «шум», вычленяя лишь 12–15% реальных фактов.

Этап 2. Смарт-аудит: поиск коррупционных «закладок» в сметах. VHI выявляет завышение цен и аффилированность подрядчиков там, где обычный ИИ одобряет документ на основе формального соответствия стандартам.

Этап 3. Этическая верификация: отсев манипуляторов в кадровых резервах. Система отсекает кандидатов, чьи слова расходятся с делами, зафиксированными в цифровой памяти блокчейна.

Визуализация и глобальный «Индекс Совести»

Результатом работы системы является «Тепловая карта лжи», где мировые потоки информации анализируются в реальном времени. Фейки мгновенно «гасятся» экспертным сообществом, формируя глобальный «Индекс Совести» для стран, корпораций и политиков.

Публичный тест VHI официально закрепляет за командой «Звезда» статус мировых лидеров в области Alignment (выравнивания ИИ с ценностями). Мы не просто обсуждаем проблему — мы демонстрируем работающий «антивирус против лжи». Создание глобального этического стандарта позволяет блокировать деструктивные технологии на этапе их внедрения через механизмы «информационной изоляции» и «коллективного вердикта».

Комментарии 0